Apple viivyttää uusia lasten turvaominaisuuksia valokuvaskannausskandaalin jälkeen

Justin Duino

Apple julkisti äskettäin monia lasten turvaominaisuuksia iOS 15:lle, mukaan lukien työkalun, joka tarkistaa automaattisesti iPhonesi lasten seksuaalista hyväksikäyttöä koskevan materiaalin (tai CSAM:n) varalta. Tällaisia työkaluja käytetään yleisesti pilvitallennus- ja viestinvälityspalveluissa, mutta Applen pyrkimys laitteiden skannaukseen johti suureen takaiskuun sosiaalisessa mediassa ja lehdistössä. Tämän seurauksena Apple lykkää kaikkia uusia lasten turvaominaisuuksia.

Apple sanoo 9to5Macille antamassaan lausunnossa, että se "päätti käyttää lisäaikaa tulevina kuukausina tiedon keräämiseen ja parannuksiin" uusiin lasten turvaominaisuuksiinsa, nimittäin CSAM-skanneriin. Se tunnustaa, että "palaute asiakkailta, asianajoryhmiltä ja tutkijoilta ja muut" johti tähän suunnitelmien muutokseen.

Silti Apple väittää, että sen CSAM-skannausjärjestelmä "on suunniteltu käyttäjien yksityisyyttä ajatellen". Ennen kuin valokuvasi tallennetaan iCloudiin, iPhone yrittää verrata niitä NCMEC:n ja muiden lastensuojeluorganisaatioiden tarjoamaan CSAM-hajautustietokantaan. Vastaavat kuvat tallennetaan sitten iCloudiin "turvakupongilla", joka on periaatteessa näkymätön lippu, jota vain Apple voi seurata.

Jos iCloud-tilisi sisältää useita CSAM-vastaavia kuvia, Apple tarkistaa kuvat manuaalisesti. Vahvistetuista lasten seksuaalisesta hyväksikäytöstä tehdyistä kuvista ilmoitetaan sitten NCMEC:lle. Apple sanoo, että tämä järjestelmä on turvallisempi kuin pilvi-skannaustekniikat, koska kuvat näkyvät yritykselle vain, jos ne on merkitty ennen iPhonesta poistumista.

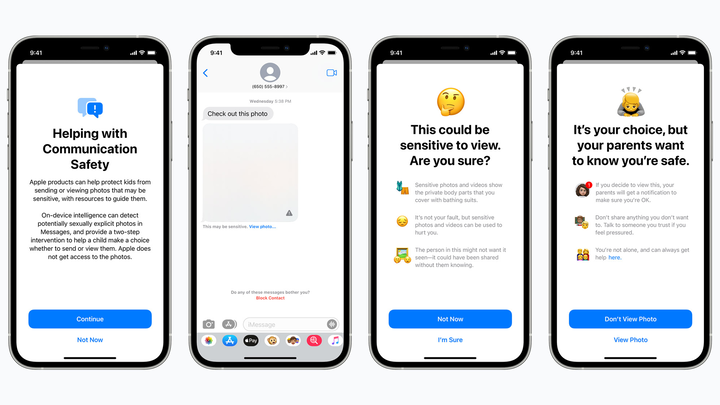

Yksi suunniteltu lasten turvaominaisuus piilottaa iMessagessa lapsilta mahdollisesti avoimen seksuaaliset kuvat ja varoittaa vanhempia, jos tällaisia kuvia avataan. Omena

Mutta yksityisyyden puolestapuhujat ovat huolissaan siitä, että Applen CSAM-skanneri havaitsee vääriä positiivisia tuloksia, mikä saattaa paljastaa yksityisiä kuvia tuntemattomille tai avata takaoven hallituksille ja huonoille toimijoille. Tekniikka voi myös luoda huonon ennakkotapauksen tulevaisuutta ajatellen – etsiikö Apple puhelimista huumeita tai muita lainvalvontaviranomaisia kiinnostavia aiheita?

Emme vieläkään tiedä, kuinka Apple aikoo "parantaa" CSAM-skanneriaan. Mutta ollakseni rehellinen, yritys ei luultavasti odottanut näkevänsä mitään vastareaktiota. Suuret nimet , kuten Google, käyttävät jo CSAM-tekniikkaa pilvi- ja viestipalveluissaan, ja Apple itse etsii CSAM:ia iCloud Mailissa.

Riippumatta siitä, missä olet, on pettymys nähdä Applen hylkäävän joitakin uusia lasten turvatyökalujaan, mukaan lukien Viestit-ominaisuuden, joka varoittaa lapsia olemasta avaamatta mahdollisesti ilkeitä valokuva- tai videoliitteitä (se ei estä lapsia avaamasta tällaisia liitteitä, mutta varoittaa vanhempia, jos he tekevät niin). Ehkä nämä ominaisuudet saapuvat tietosuojaparannuksilla muutaman kuukauden kuluttua iOS 15:stä, mutta Applen suunnitelmat ovat jälleen hyvin epäselviä.